Introduction à l'algorithme de clustering K-Means?

Le clustering K-Means appartient à l'algorithme d'apprentissage non supervisé. Il est utilisé lorsque les données ne sont pas définies dans des groupes ou des catégories, c'est-à-dire des données sans étiquette. Le but de cet algorithme de clustering est de rechercher et de trouver les groupes dans les données, où la variable K représente le nombre de groupes.

Comprendre l'algorithme de clustering K-Means

Cet algorithme est un algorithme itératif qui partitionne l'ensemble de données en fonction de leurs caractéristiques en un nombre K de clusters ou sous-groupes distincts prédéfinis ne se chevauchant pas. Il rend les points de données des inter-clusters aussi similaires que possible et essaie également de maintenir les clusters autant que possible. Il alloue les points de données à un cluster si la somme de la distance au carré entre le centroïde du cluster et les points de données est au minimum où le centroïde du cluster est la moyenne arithmétique des points de données qui sont dans le cluster. Une variation moindre dans le cluster entraîne des points de données similaires ou homogènes au sein du cluster.

Comment fonctionne l'algorithme de clustering K-Means?

K- Means Clustering Algorithm a besoin des entrées suivantes:

- K = nombre de sous-groupes ou grappes

- Échantillon ou ensemble de formation = (x 1, x 2, x 3, ……… x n )

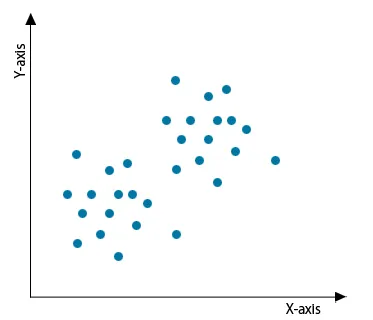

Supposons maintenant que nous ayons un ensemble de données sans étiquette et que nous devons le diviser en grappes.

Maintenant, nous devons trouver le nombre de clusters. Cela peut être fait par deux méthodes:

- Méthode du coude.

- Méthode du but.

Laissez-nous en discuter brièvement:

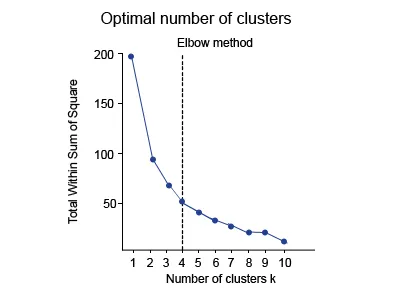

Méthode du coude

Dans cette méthode, une courbe est tracée entre «dans la somme des carrés» (WSS) et le nombre de grappes. La courbe tracée ressemble à un bras humain. On l'appelle la méthode du coude car le point du coude dans la courbe nous donne le nombre optimal de grappes. Dans le graphique ou la courbe, après le point du coude, la valeur de WSS change très lentement, donc le point du coude doit être considéré pour donner la valeur finale du nombre de grappes.

Basé sur le but

Dans cette méthode, les données sont divisées en fonction de différentes métriques et ensuite, il est jugé à quel point elles ont bien fonctionné pour ce cas. Par exemple, la disposition des chemises dans le département de vêtements pour hommes dans un centre commercial se fait sur les critères des tailles. Cela peut être fait sur la base du prix et des marques également. Le mieux adapté serait choisi pour donner le nombre optimal de grappes, c'est-à-dire la valeur de K.

Maintenant, revenons à notre ensemble de données ci-dessus. Nous pouvons calculer le nombre de grappes, c'est-à-dire la valeur de K en utilisant l'une des méthodes ci-dessus.

Comment utiliser les méthodes ci-dessus?

Voyons maintenant le processus d'exécution:

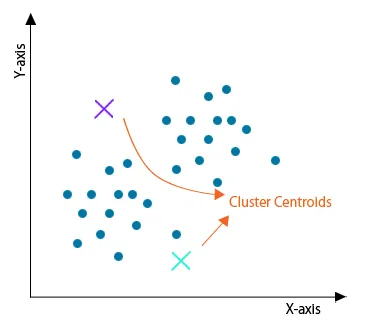

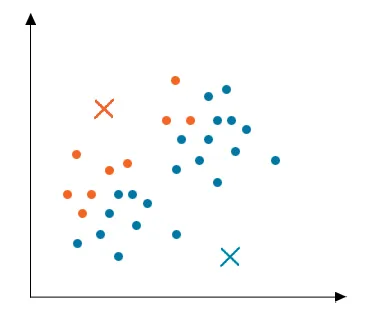

Étape 1: initialisation

Tout d'abord, initialisez tous les points aléatoires appelés centres de gravité du cluster. Lors de l'initialisation, vous devez vous assurer que les centroïdes du cluster doivent être inférieurs au nombre de points de données d'entraînement. Cet algorithme est un algorithme itératif, les deux étapes suivantes sont donc exécutées de manière itérative.

Étape 2: affectation de cluster

Après l'initialisation, tous les points de données sont parcourus et la distance entre tous les centroïdes et les points de données est calculée. Maintenant, les grappes seraient formées en fonction de la distance minimale des centroïdes. Dans cet exemple, les données sont divisées en deux clusters.

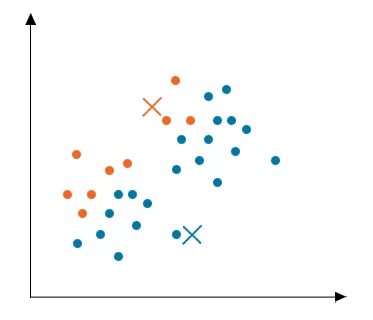

Étape 3: déplacement du centroïde

Comme les grappes formées à l'étape ci-dessus ne sont pas optimisées, nous devons donc former des grappes optimisées. Pour cela, nous devons déplacer les centroïdes de manière itérative vers un nouvel emplacement. Prenez les points de données d'un cluster, calculez leur moyenne, puis déplacez le centre de gravité de ce cluster vers ce nouvel emplacement. Répétez la même étape pour tous les autres clusters.

Étape 4: optimisation

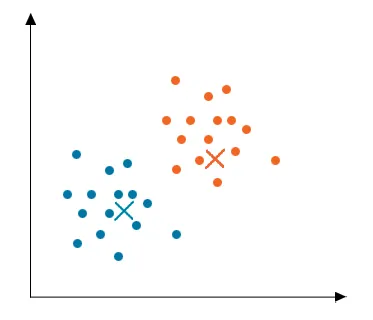

Les deux étapes ci-dessus sont effectuées de manière itérative jusqu'à ce que les centroïdes cessent de bouger, c'est-à-dire qu'ils ne changent plus de position et soient devenus statiques. Une fois cela fait, l'algorithme k- means est appelé à converger.

Étape 5: Convergence

Maintenant, cet algorithme a convergé et des grappes distinctes sont formées et clairement visibles. Cet algorithme peut donner des résultats différents selon la façon dont les clusters ont été initialisés lors de la première étape.

Applications de l'algorithme de clustering K-Means

- Segmentation du marché

- Regroupement de documents

- Segmentation d'image

- Compression d'image

- Quantification vectorielle

- L'analyse par grappes

- Apprentissage des fonctionnalités ou apprentissage du dictionnaire

- Identification des zones sujettes à la criminalité

- Détection de fraude à l'assurance

- Analyse des données des transports publics

- Regroupement des actifs informatiques

- Segmentation de la clientèle

- Identification des données cancéreuses

- Utilisé dans les moteurs de recherche

- Prédiction de l'activité médicamenteuse

Avantages de l'algorithme de clustering K-Means

- C'est rapide

- Robuste

- Facile à comprendre

- Comparativement efficace

- Si les ensembles de données sont distincts, donne les meilleurs résultats

- Produisez des grappes plus serrées

- Lorsque les centroïdes sont recalculés, le cluster change.

- Souple

- Facile à interpréter

- Meilleur coût de calcul

- Améliore la précision

- Fonctionne mieux avec les clusters sphériques

Inconvénients de l'algorithme de clustering K-Means

- Nécessite une spécification préalable pour le nombre de centres de cluster

- S'il y a deux données qui se chevauchent fortement, elles ne peuvent pas être distinguées et ne peuvent pas dire qu'il y a deux clusters

- Avec la représentation différente des données, les résultats obtenus sont également différents

- La distance euclidienne peut inégalement pondérer les facteurs

- Il donne les optima locaux de la fonction d'erreur au carré

- Parfois, le choix des centroïdes au hasard ne peut pas donner de résultats fructueux

- Ne peut être utilisé que si la signification est définie

- Ne peut pas gérer les valeurs aberrantes et bruyantes

- Ne fonctionne pas pour l'ensemble de données non linéaire

- Manque de cohérence

- Sensible à l'échelle

- Si de très grands ensembles de données sont rencontrés, l'ordinateur peut se bloquer.

- Problèmes de prédiction

Articles recommandés

Cela a été un guide pour l'algorithme de clustering K-Means. Ici, nous avons discuté du fonctionnement, des applications, des avantages et des inconvénients de l'algorithme de clustering K-Means. Vous pouvez également consulter nos autres articles suggérés pour en savoir plus -

- Qu'est-ce que les réseaux de neurones?

- Qu'est-ce que l'exploration de données? | Rôle de l'exploration de données

- Question d'entretien de Data Mining

- Apprentissage automatique vs réseau neuronal

- Clustering dans l'apprentissage automatique